全球 AI 迷引頸期盼「AI 界超級盃」來了,在 2026 年輝達 GTC 大會主題演講中,輝達執行長黃仁勳勾勒出人工智慧產業下一階段的發展藍圖,並提出多項新技術與長期布局,顯示 AI 基礎設施正從晶片競賽進一步走向完整的運算生態系。

輝達 2027 年先進 AI 晶片商機達 1 兆美元

去年 10 月輝達曾預估 Blackwell 與 Rubin AI 平台帶來的營收可見度超過 5000 億美元,黃仁勳在演講中公布更驚人的營收預期。

黃仁勳表示,Blackwell 與 Vera Rubin 兩代 AI 晶片至 2027 年的整體營收機會至少達 1 兆美元,顯示全球企業與新創公司對 AI 算力需求仍然強勁。此消息引發輝達尾盤一度急升,但隨後有所回落,收高約 1.4%。

黃仁勳提出「代幣工廠 (Token Factory)」概念,認為未來資料中心的角色將從傳統資料儲存設施,轉變為生產 AI 推理代幣的智慧工廠。

輝達強調,透過高度整合的硬體與軟體協同設計,其系統能大幅降低單位代幣成本,使企業未來必須像管理資產一樣管理「代幣產出率」。

Vera Rubin 架構與 Groq 技術結合

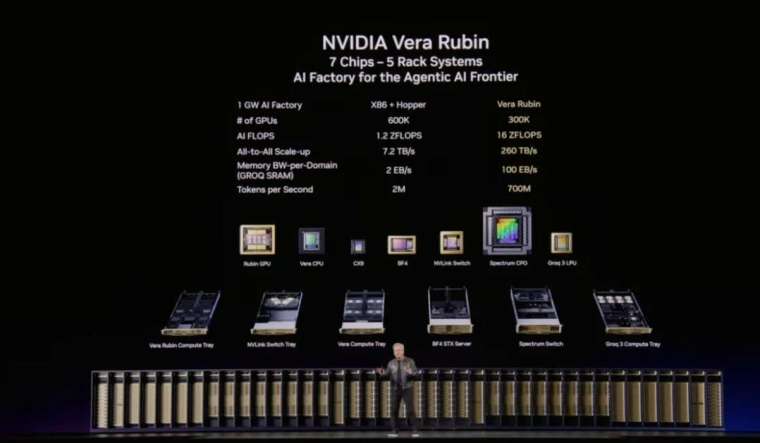

輝達新一代 AI 基礎設施平台 Vera Rubin,整合七款晶片與五種機架系統,打造專為「代理 AI」(Agentic AI) 設計的超級運算平台。

黃仁勳認為:「代理式 AI 的轉折點已經到來,Vera Rubin 將開啟歷史上最大規模的基礎設施建設浪潮。」

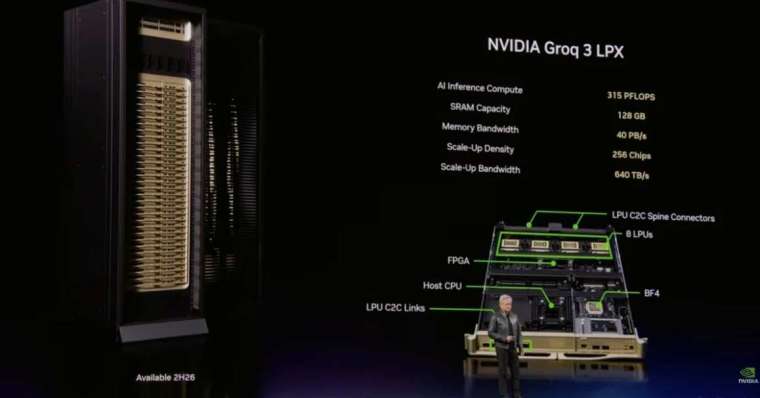

根據黃仁勳公布的最新產品藍圖,輝達在與 AI 晶片新創公司 Groq 建立合作關係後,已將 Groq 的 LPU(語言處理單元) 納入長期產品規畫。

Vera Rubin 平台整合 Vera CPU、Rubin GPU、NVLink 6 交換器、ConnectX-9 SuperNIC、BlueField-4 DPU、Spectrum-6 乙太網路交換器,以及 Groq 3 LPU 推論加速器,形成完整 AI 工廠架構。

Groq 3 LPX 機架主打低延遲推論與百萬 Token 級上下文處理能力,與 Rubin GPU 協同運算時,推論吞吐量最高可提升 35 倍。

Vera Rubin 平台已獲 AWS、Google Cloud、微軟 Azure、Oracle Cloud、CoreWeave 等雲端業者支持,思科、戴爾、HPE、聯想與廣達、緯創、鴻海、華碩、技嘉等硬體廠也將推出相關系統。

輝達表示,基於 Vera Rubin 架構的產品預計自 2026 年下半年起陸續上市。

輝達發布全新 Vera CPU

除了 GPU,輝達也強調自身在 CPU 領域的布局,發布全新 Vera CPU,定位為「全球首款專為代理式 AI 與強化學習設計的處理器」,並作為 Vera Rubin AI 平台的核心運算中樞。

Vera CPU 採用 88 個自研 Olympus 核心,專門處理代理式 AI 的任務規劃、資料調用、程式執行與結果驗證等邏輯工作,整體結果產出效率提升 2 倍、運行速度提升約 50%。

黃仁勳表示,新推出的 Vera CPU 在單執行緒效能、資料輸出與資料處理能力方面表現突出,同時具備極高的能源效率。

他指出,Vera CPU 的設計目標是與 Vera Rubin 平台的機架系統整合,支援代理式 AI 的大規模運算需求。

Vera CPU 透過 NVLink-C2C 技術與 Rubin GPU 連接,提供最高 1.8 TB/s 傳輸頻寬,是 PCIe Gen6 的約 7 倍,強化 CPU 與 GPU 的協同運算能力。

包括阿里巴巴、字節跳動、Meta、Oracle、CoreWeave 等雲端業者,以及 Dell、HPE、聯想、華碩、技嘉、廣達、緯創等硬體廠商均計劃導入 Vera CPU。

Vera CPU 的推出意味輝達正從 GPU 供應商轉型為完整 AI 基礎設施平台商,並對英特爾與 AMD 主導的伺服器 CPU 市場形成正面競爭。

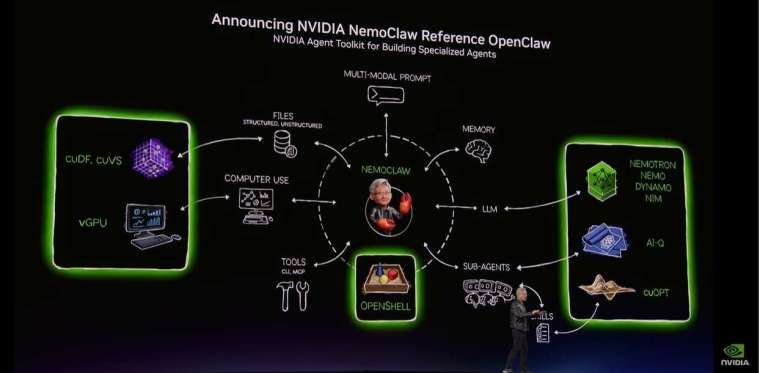

加入 OpenClaw 熱潮 推出 NeMoClaw

開源 AI 代理 OpenClaw(此前稱為 Clawdbot 與 Moltbot) 自去年秋季推出後迅速在開發者社群爆紅,如今輝達也正式加入這股浪潮。

黃仁勳宣布推出 NemoClaw 開源企業級 AI 代理平台,強調該平台將為 OpenClaw 生態提供隱私與安全機制,包括整合 OpenShell,同時降低企業導入 AI 代理系統的門檻。

黃仁勳表示,如今全球企業都需要制定 OpenClaw 策略,也就是建立代理式 AI 系統 (agentic system) 的策略。

未來軟體產業將逐步從 SaaS(軟體即服務) 轉向 AaaS(智慧體即服務) 的新模式。

物理 AI 爆發 從自動駕駛到「雪寶」現身

黃仁勳在演講中也展示實體 AI 的快速發展,並指出自動駕駛技術已進入大規模商用階段。

輝達 RoboTaxi Ready 平台新增比亞迪、現代與吉利等汽車製造商合作夥伴,相關平台未來可涵蓋每年約 1,800 萬輛新車。同時,輝達也與 Uber 達成合作部署計畫。

黃仁勳演說會場一大亮點之一,是迪士尼機器人角色「雪寶」(Olaf) 登場,展示透過 Omniverse 與 Newton 物理解算器在虛擬世界中訓練後,機器人如何具備更強的物理適應與動作能力。

Feynman (費曼) 平台

輝達預計 2028 年推出次世代加速運算平台 Feynman (費曼),將首次採用裸晶 (die) 堆疊設計,並整合客製化高頻寬記憶體(HBM)。

同時,系統將透過 NVLink 技術與 LP40 LPU 互連,強化與 GPU 之間的協同運算效率。

Feynman 世代也將導入名為 Rosa 的新一代 CPU,並搭配下一代 BlueField-5 DPU,還將進一步擴展光電融合架構。

近期市場熱議輝達在大型 AI 系統互連技術上究竟會選擇光纖還是銅纜。黃仁勳在演講中給出簡單答案:「兩者都會用。」

黃仁勳稱,Feynman 將首次同時採用銅纜與共封裝光學 (co-packaged optics) 進行系統擴展,以增加更多 AI 推論所需傳輸頻寬。

太空運算布局

輝達的布局已不再侷限於地球上的資料中心,而是將目光延伸至太空運算基礎設施。

輝達推出為太空設計的硬體,像是 Space-1 Vera Rubin 平台,採用全新 AI 加速運算架構,相較 NVIDIA H100 可實現 25 倍的太空 AI 運算能力。

黃仁勳表示,未來輝達希望在太空建造資料中心。由於地球上土地與能源供應逐漸成為限制,一些科技企業正探索將資料中心部署在太空的可能性。

不過黃仁勳也坦言,這項計畫面臨巨大技術挑戰。

他指出,在太空環境中沒有熱傳導與對流,只有輻射散熱,因此如何為太空資料中心設計有效的冷卻系統,將成為關鍵問題。